2022年11 月 30 日,OpenAI 的网站向公众开放了这款由人工智能驱动的聊天机器人ChatGPT——一种模拟人类对话的软件——虽然它仍处于研究审查阶段,但用户可以免费注册和测试。

此后这个对话机器人迅速火爆,在短短几个月时间里就有了1亿访问用户。

ChatGPT的火爆在技术领域激起无数狂热,业界形容它的诞生是人工智能时代的“iPhone时刻”。微软在Bing中整合ChatGPT对话,Google匆忙退出Bard,中国的一众互联网巨头纷纷公布自己的AI计划,包括一些已经在互联网行业中淡出的前辈也突然决定重回AI技术创业浪潮。

VIA GETTY IMAGES

ChatGPT作为一个名词是Chat Generative Pre-trained Transformer的缩写,本身是由OpenAI开发的一个人工聊天机器人程序,在去年11月退出。该程序使用基于GPT-3.5架构的大型语言模型并通过强化学习进行训练。ChatGPT目前仍以文字方式交互,而除了可以通过人类自然对话方式进行交互,还可以用于相对复杂的语言工作,包括自动文本生成、自动问答、自动摘要等在内的多种任务。(wikipedia)

ChatGPT通过自然语言聊天的方式,是它能走向公众,并让公众理解的重要原因,这个recall了图灵测试的基本逻辑。

人工智能AI的辉煌时刻

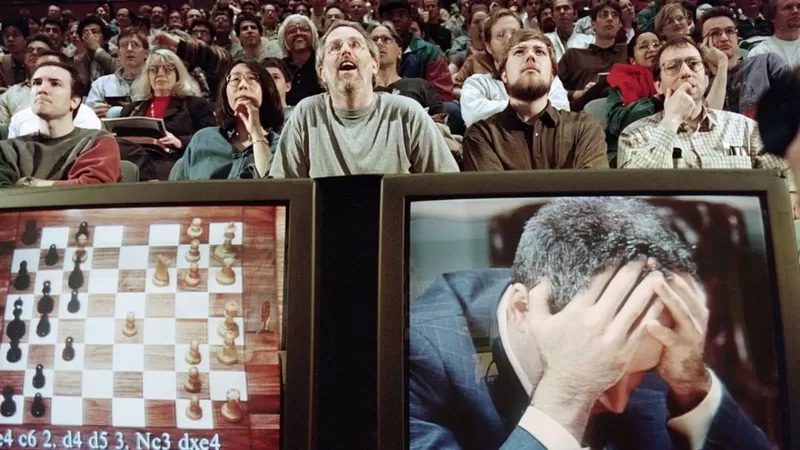

1997年,超级电脑深蓝(Deep Blue) 打败了国际象棋世界卫冕冠军加里·卡斯帕罗夫(Garry Kasparov),成为人工智能史上里程碑。

深蓝的胜利是人工智能发展史上的一个重要时刻。

而在此之后,人工智能的进步却难以在公众产生更大影响力,直到OpenAI推出的ChatGPT。

ChatGPT通过了一系列对人类难度较高的专业级测试:它新近通过了谷歌编码L3级(入门级)工程师测试;分别以B和C+的成绩通过了美国宾夕法尼亚大学沃顿商学院MBA的期末考试和明尼苏达大学四门课程的研究生考试;通过了美国执业医师资格考试……(via)。

以前认为不会被AI取代的知识型工作它也足以胜任。

香港科大早前曾在学校禁止在功课中使用ChatGPT,但近期向教职员工发信指出,经各部门商讨认为人工智能长远来说可加强教学,决定让教职员自行选择会否限制学生使用 ChatGPT,或可有限度自行选择使用 ChatGPT 的方式。学生使用 ChatGPT 后也应在报告中列明。(via)

科罗拉多州的一位特殊教育老师Eli Snyder 用ChatGPT完成了为全部残疾和自闭症的学生创建个体化的体育运动计划,这只用了5分钟!

某些新闻网站早已开始用智能化程序来撰写相当程式化的新闻和简讯,比如股市动态和天气预报。德国报业集团斯普林格(Axel Springer)执行长杜普纳(Mathias Doepfner)在给员工的内部信件中提到:“人工智慧(AI)有可能让独立新闻业比以往任何时候都好,又或者直接取而代之。”

美国科幻杂志“克拉克世界”编辑表示,聊天机器人ChatGPT自去年推出以来,AI产制的稿件氾滥,投稿拒绝率飙升

德克萨斯州的一名视频游戏设计师,使用 ChatGPT 来帮助她集思广益地为角色命名、构思预告片的创意并为她的游戏制作新闻稿。

借助ChatGPT,你可以编写简单的计算机任务程序,可以为视频撰写脚本,创作一些奇怪风格的小说场景,也包括一些看起来是那么回事但却毫无美感的诗歌……

一个问题必然被公众提出:ChatGPT会抢走我的工作吗?

仿佛是为了安慰惶恐的人类,ChatGPT是这么回答的——

ChatGPT 技术本身并不会直接替代某些职业,但是它可以在某些领域提供更高效、更准确的问答和对话服务。例如,它可以在客户服务、在线教育、智能语音助手等领域发挥作用。但是,对于某些需要人类智慧和情感的职业,如医生、律师、心理咨询师等,ChatGPT 技术的应用可能相对有限。

人类应该警惕AI

很多观察者担忧,AI对人类世界的渗透可能是打开了潘多拉的盒子?

科幻片《2001:太空漫游》中,机器人电脑拒绝被关闭。

但任何新技术都有所谓的两面性,就像汽车、互联网和机器人,它们的确毁灭了旧世界,但同时开创了新时代,人类社会的变革就是在破坏与重建的过程中前进的,因此对AI的恐惧,极大可能也是人类对未知的恐惧而已。

但一些人类最智慧的脑袋却在不断提醒人类,从英国著名理论物理学家史蒂芬·霍金到特斯拉创始人伊隆·马斯克等世界顶尖人工智能(AI)专家,都曾表示过人工智能对人类生存的威胁。

3月2号的Tesla投资者日上,马斯克说:“我们需要某个机构或机制,来监督人工智慧的发展…以确保符合公众利益。这是一种相当危险的技术。我担心自己可能已经做了一些事,加速了它的发展。”

特斯拉与推特执行长马斯克在特斯拉投资人日表示,政府应该出手管一管人工智慧(AI)领域的发展。(路透社)

加州大学伯克利分校的斯图尔特·罗素教授(Stuart Russell)是人工智能领域的专家,在他的《人类相容:人工智能与控制问题》(Human Compatible: AI and the Problem of Control)一书中指出,这种威胁并非来自机器人开始有了自我意识,并起来反抗人类主人,而是因为这些机器人能力变得超强,最后有可能是因为人类的疏忽,为机器人设置了错误的目标,让他们无意中把我们都消灭了。(bbc)

罗素说,我们现在发明的AI系统有点像传说中的神灯中的精灵一样,你轻拍神灯,灯里的精灵出来了。你对精灵说:“你给我做这件事吧。”

“如果AI系统足够强大,它就会完全按照你的要求去做,你也会得到你所要求的一抹一样的结果。”

但罗素表示,问题是跟神灯中的精灵故事那样,第三个愿望总是要求精灵“取消前面的那两个愿望”,因为我们无法确定自己到底想要什么。

其结果就可能造成,那个试图完成错误指令的机器人实际上变成了人类的敌人,一个比我们强大得多的敌人。

到那时,一切就太晚了。

尾声

也许,与其关心人工智能是否会毁灭人类,我们更应该关心谁控制了人工智能技术。

留下评论